在VMware on AWS Cloud上运行人工智能工作负载的最大好处之一就是他们能够利用Amazon基础设施的“弹性”。

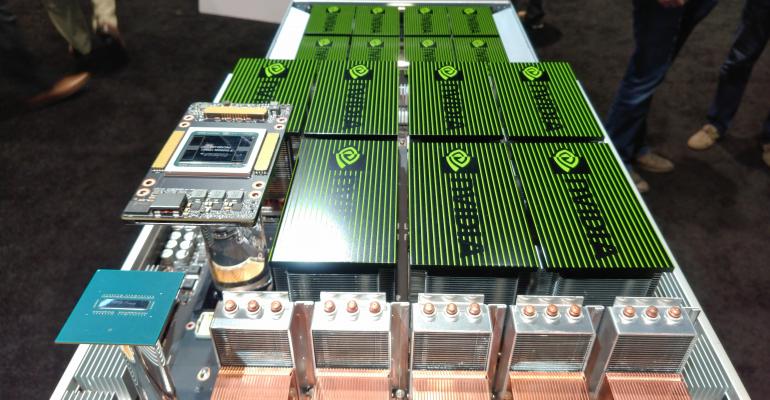

人工智能巨头Nvidia正在公有云上实现人工智能和机器学习,发布了运行在VMware on AWS Cloud上的“加速GPU服务”。

在VMworld 2019大会上Nvidia宣布推出这项新服务,可以轻松地将现有基于vSphere的应用和软件容器迁移到VMware on AWS Cloud上,后者是一种混合云平台,可以在AWS的公有云上运行VMware的软件定义数据中心堆栈。

这些应用一旦被重新部署,就可以通过Nvidia的高性能GPU利用包括高性能计算、机器学习、数据分析和视频处理应用等新技术。

Nvidia认为,人工智能工作负载(如图像和语音识别、财务建模和自然语言处理)最好在是在自己的GPU硬件上完成的,因为与传统的CPU相比,GPU大大加快了训练和推理时间。

这项新服务采用Amazon的EC2裸机实例和Nvidia新的Virtual Compute Server软件,并将这些与Nvidia T4 GPU相结合以加速人工智能工作负载。

Nvidia创始人兼首席执行官黄仁勋表示:“从运营智能再到人工智能,企业依靠GPU加速计算以做出给他们带来直接影响的、快速准确的预测。我们与VMware一起,正在设计最先进、性能最高的GPU加速混合云基础设施,以促进整个企业的创新。”

Nvidia表示,在VMware on AWS Cloud上运行人工智能工作负载的最大好处之一就是他们能够利用Amazon基础设施的“弹性”。这项新服务将使客户能够根据需要扩展人工智能工作负载,根据数据科学家的需求扩大和缩小他们的训练环境。

其他好处包括提高人工智能应用的安全性和可管理性,更不用说还可以提高可移动性。Nvidia表示,客户只需点击一下按钮就可以在VMware on AWS Cloud和本地环境之间迁移应用,无需停机。

市场研究公司Wikibon分析师James Kobielus表示,Nvidia与VMware的合作意味着VMware现在可以为客户提供高性能的人工智能计算基础设施,这是以前无法做到的。

“通过这种合作伙伴关系,VMware客户可以轻松地将在裸机CPU上运行的人工智能工作负载转移到运行在VMware on AWS Cloud上Nvidia最新最快的GPU虚拟化集群,这将使VMware相比其他混合云解决方案提供商(例如IBM和HPE)在运行企业客户最先进人工智能应用方面占据了优势。”

同样在周一,该公司宣布了一项解决混合云机会的广泛战略,该战略主要是提供一套工具,以统一的方式管理所有企业基础设施,内部和/或任何公共云。

Nvidia可以为公司增加数据中心消费GPU的另一种方式,但它也使RAPIDS,它的AI库和数据科学家的分析软件工具与这个虚拟GPU基础设施兼容。容器化的软件包使TensorFlow和PyTorch等流行的数据科学技术能够利用GPU加速的硬件。

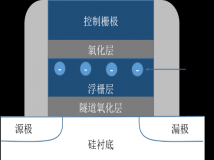

关键的支持技术是Nvidia的虚拟计算服务器(或vComputeServer)软件,GPU巨头周一也宣布了该软件。它基于该公司以前存在的虚拟GPU技术,但直到现在它才支持基于KVM的开源虚拟机管理程序,如Red Hat和Nutanix。vGPU现在支持vSphere,而vComputeServer是该支持的产品表现形式。

VMware还拥有自己的大型硬件加速器虚拟化工作。7月,该公司宣布收购该领域的专家Bitfusion,称其目标是将GPU虚拟化引入vSphere。VMware还表示,该平台可以扩展,以支持其他类型的硬件加速器,如FPGA和定制ASIC。

与CPU虚拟化一样,Nvidia的vComputeServer对GPU基础架构提出了性能“税收”。税收的确切规模因工作量而异,但Nvidia工程师在实验室中观察到的对性能的一般影响不到5%,

声明: 此文观点不代表本站立场;转载须要保留原文链接;版权疑问请联系我们。