正在组建一个由顶级机器学习研究人员和工程师组成的团队,致力于解决超级智能对齐问题。

(thinkhubstudio/Shutterstock)

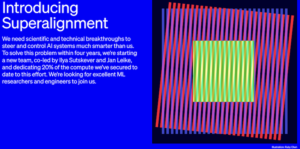

如果人工智能有一天超越人类的智力会怎样?这种“超级智能”是OpenAI所期待的——可能是在这十年内——该公司已经组建了一个新团队,专注于使其与人类的最佳利益保持一致。

“我们如何确保人工智能系统比人类更聪明地遵循人类的意图?”OpenAI博客文章宣布了一个名为Superalignment的新团队,该团队将由该帖子的作者Ilya Sutskever和Jan Leike共同领导。

该公司表示,它正专注于缓解超级智能人工智能系统,而不是通用人工智能(AGI),以“强调更高的能力水平”。Sutskever和Leike表示,目前没有控制超级智能人工智能的方法,现有的对齐策略,如从人类反馈中进行强化学习,将不适用于超越我们自身能力的系统。

该公司表示,它正在组建一个由顶级机器学习研究人员和工程师组成的团队,致力于解决超级智能对齐问题:“我们的主要基础研究赌注是我们新的超级对齐团队,但做到这一点对于实现我们的使命至关重要,我们希望许多团队做出贡献,从开发新方法到扩展它们再到部署。“作者写道。

(来源:OpenAI)

Sutskever是OpenAI的联合创始人兼首席科学家。Leike领导OpenAI的对齐团队,其对齐研究方法侧重于三大支柱:使用人类反馈训练AI系统,培训AI系统以协助人类评估,以及培训AI系统进行对齐研究。Leike在一条推文中表示,以前的对准团队大部分都加入了新的超级对准团队。

OpenAI还将在未来四年内将其迄今为止获得的计算的20%用于这一追求。在另一条推文中,Leike表示“20%的计算不是一个小数目”,他“对OpenAI愿意以这种规模分配资源印象深刻”。

“这是有史以来最大的对齐投资,可能比人类迄今为止在对齐研究上花费的总金额还要多,”Leike写道。

超级对齐团队的任务是在四年内解决超级智能对齐的核心技术挑战。这篇博文概述了该团队的工作将如何围绕提高ChatGPT等当前模型的安全性,理解和减轻人工智能风险,如滥用,经济破坏,虚假信息,偏见和歧视,以及成瘾和过度依赖。

作者还表示,社会技术问题 - 或与人类和机器一起工作有关的问题 - 也将是一个关注领域。OpenAI表示,它正在积极与跨学科专家合作,以“确保我们的技术解决方案考虑到更广泛的人类和社会问题”。

该团队概述了其第一个目标:建立一个大致人类水平的自动化对齐研究人员。“然后,我们可以使用大量的计算来扩展我们的工作,并迭代地调整超级智能。

该团队写道,为此,研究人员需要开发一种可扩展的训练方法,验证生成的模型,并对整个对齐管道进行压力测试。压力测试将涉及为人类难以评估的任务提供训练信号,以便人工智能系统可用于评估其他人工智能系统。它还涉及自动搜索和解释有问题的行为。

“最后,我们可以通过故意训练错位模型来测试我们的整个管道,并确认我们的技术检测到最糟糕的错位(对抗性测试),”作者写道。

“你怎么知道你是失败了,还是进步不够快?”Eliezer Yudkowsky问Leike回应这个消息。Yudkowsky是一位有争议的AI研究人员,他的观点是AI对齐问题无法解决。

“我们会盯着经验数据,因为它进来了,”Leike回答道。“我们可以在研究路线图的各个部分(例如可扩展的监督)上在本地衡量进展,我们可以看到 GPT-5 的对齐情况如何。我们将密切关注技术的发展速度。

声明: 此文观点不代表本站立场;转载须要保留原文链接;版权疑问请联系我们。